“地学”K2乔戈里,上交大团队推出一个70亿参数的地球科学大语言模型

今天,很高兴为大家分享来自机器之心Pro的K2乔戈里,上交大团队推出一个70亿参数的地球科学大语言模型,如果您对K2乔戈里,上交大团队推出一个70亿参数的地球科学大语言模型感兴趣,请往下看。

说到世界上最高的山峰大家都能想到是珠穆朗玛峰,但是世界上的第二高峰就鲜有人知 —— 乔戈里峰(又称 K2,仅以 200 多米之差屈居第二)。珠穆朗玛峰固然高大雄伟,但是乔戈里峰的攀爬难度却远超珠穆朗玛峰,在登山界享有盛名,即使是最简单的登顶路线也需要穿越地形复杂的冰川,攀缘几乎垂直的峭壁,经过许多很容易倒塌的冰柱。来自上海交通大学的科研团队,将第一个地球科学的大模型就被命名为乔戈里峰,就源于此。

地球科学是一门古老的学科,不仅研究岩石、矿物和土地的性质,还探讨地球的气候、海洋、大气、生态系统等多个方面现象和原理。地学与我们的日常生活息息相关,帮助我们预测天气,了解地球的演化历史,维护海洋生态系统平衡和海洋资源均衡等。同时火山活动、地震、恐龙化石、气象现象等引人入胜的内容,也被一个个地学工作者阐述出来,带给大家一个又一个令人惊奇和引人入胜的故事。

总的来说,地球科学是一门理论性、应用性都很强的自然科学。从理论性上来说,它承担着揭示自然界奥秘与规律的使命。从应用性上来看,它为生活在地球上的人类如何适应、利用、保护自然提供了科学的方法论。但是一味的通过传统的理论和实践的方法并不能高效的发现新的地学理论,整合传统的地球科学和利用计算机科学的处理大数据成了地球科学的新科研范式。

很长一段时间以来,计算机科学已经成为地球科学不可或缺的一部分。地球科学涉及大量的数据,包括文献数据、地质数据、气象数据、遥感数据等。计算机科学提供了处理、存储和分析这些海量图片、文本和数字等模态的数据的工具和技术。这两个学科的交叉融合已经成为大势所趋。

其中,文本数据挖掘是重要的但是最容易被忽视的一个重要组成部分。从大量的文本数据中提取有关地球科学的信息、模式和趋势,可以加深对地球科学的理解,并为科学研究、决策制定和问题解决提供支持。与此同时,近年大火的语言模型又是文本数据挖掘重要的工具。因此,在这样的一个属于大语言模型的时代,推出一个地球科学这个垂直领域的基座语言模型势在必行。

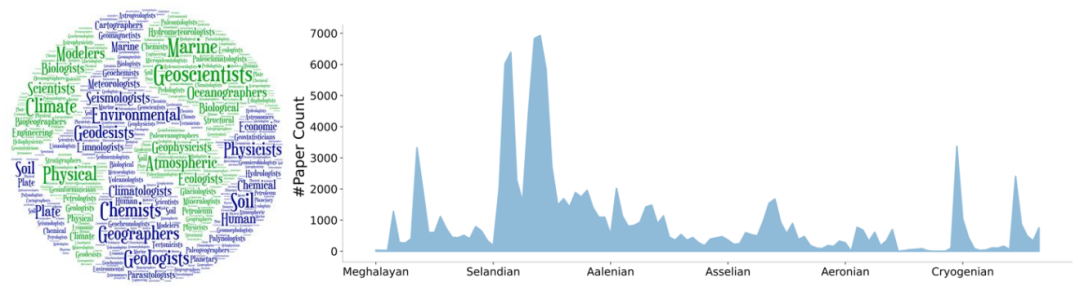

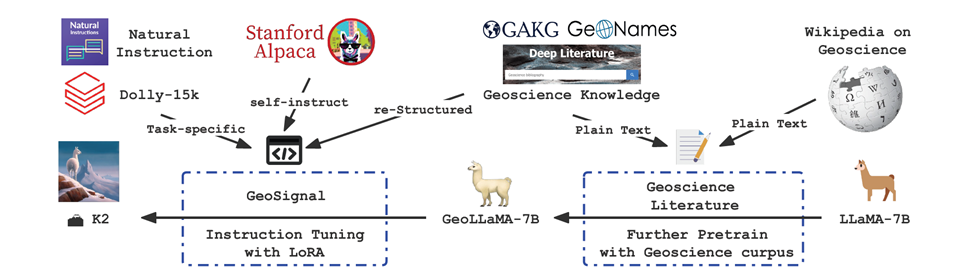

最近,来自上海交通大学的团队推出一个 70 亿参数的地球科学大语言模型名叫 K2。K2 是基于初代 LLaMA-7B 模型,并使用了 100 万余篇地球科学文献以及和地球科学相关的维基百科的文章进行更进一步的预训练。同时设计了第一个地球科学领域的微调数据集 GeoSignal,包含文章内容、类别、参考文献、提到的实体等,适用于解决回答地球科学方面的专业问题、完成命名实体提取、地学概念上下位关系判断等任务。

区别于大多数垂直领域的模型训练的思路,该团队通过独特的数据重构技术生成指令微调的数据,而不仅仅是利用 self-instruct 等方法,利用 ChatGPT 生成的数据来进行指令数据的采集。

同时为了评估模型在地学知识的理解和应用方面的能力,他们还建立了第一个地球科学语言模型的基准 GeoBenchmark,它主要由中国的地理、地质学的考研题目和美国的地理、地质与环境科学的 AP 考试题目组成。有意思的是,ChatGPT 和 GPT4 在地学相关的 AP 考试上的分数并没有随着 GPT4 的技术报告一同给出,留给大家十足的想象空间。

在大模型纷争的时代,大多数垂直领域的大模型训练都有统一的范式,那就是先进行专业领域语料的预训练,再进行指令微调。但是大多数的模型在预训练阶段使用的数据并不透明,指令微调的数据更多的是蒸馏 ChatGPT 来抑或进行高价的人工标注。但是 K2 针对地学这一个垂直领域给出了一套技术路线,从计算机角度通过数据的整合和提炼来进行学科交叉的知识工程和模型构建,这是 K2 之于数据挖掘和自然语言领域的贡献之一。

针对预训练数据,该团队基于 Grobid,PyPDF2 和 DeepShovel (https://deepshovel.deep-time.org/) 等工具开发了一套数据清洗工具包。

DeepShovel:是一款辅助地学科学家进行知识抽取的文献标注平台,也陆续推广至所有的学术领域。目前 DeepShovel 以及辅助超过一百家地球科学的科研单位。

其中,每一篇地学开放获取(Open Access)的论文都会被转化成对于计算机来说可读性极高的 Markdown 格式的文本,有着多级标题的区分、公式和引用的特殊词元(Special Token)以及图片和表格的注释文本也被特殊词元保存下来。经过一系列的操作,累计获取了 5.5B 词元(Tokens)的文本语料。目前他们正在构建更大的学术资源的语料,旨在进行更大规模的学术大模型的训练。

针对指令微调数据,该团队通过多个自主研发平台上的数据融合,通过数据重构,将具备一定结构化的网页进行了解构,并重组成一套 knowledge-intensive 的数据。在这个过程中,上海交通大学团队集中团队内部所有的平台课题组的力量,进行数据的充分重组,从而构建了一套独一无二的具有特定地学任务的知识性指令微调数据集。

据论文描述,上海交通大学团队在过去的 3 年,相应 DDE 大科学计划(https://deep-time.org/)的号召,完成研发的地学数据和功能平台共 4 个。

Deep literature

https://ddescholar.acemap.info/

致力于打造地学领域的 DBLP,将所有的地学学术文献进行整合并依托这个平台进行一系列的数据挖掘和学者画像的分析。

GAKG

https://gakg.acemap.info/

致力于打造地学领域的多模态学术知识图谱,对所有的地学学术文献进行数据的挖掘,抽取文献之间的关联关系、地学知识点之间的上下位等语义关系以及地学文献内的知识挖掘。对外提供了语义查询和文本搜索系统,也是 CIKM 历史上第一篇地球科学相关的科研文章。GAKG 对外也提供了数据下载、语义查询和文本搜索的平台。同时,GAKG 的技术工作也发表在 CIKM 上,也是一篇计算机科学领域与地球科学交叉研究的科研文章。

GSO

https://gso.acemap.info/

是利用机器生成人工修正的地学知识树系统,用上下位关系维护了地学知识点之间的关联,这给大模型提供了很好的地学知识链接预测的监督信号。

DataExpo

https://dataexpo.deep-time.org/

通过关键词检索以及文本分类归纳了所有的地学数据集。

这些平台承载着地学的知识元数据,如果通过人工整合平台底层的数据逻辑,将可以很快的获得地学知识之间关联关系,以及一定的任务驱动的数据集。

基于 DDE Scholar 可以获得地学相关的科研文献,并且通过其中 OA 的文献的下载链接,可以下载下来构建预训练语料,通过 GAKG,可以构建实体抽取的数据集,语义上下位词的知识判断的数据集。通过 DeepShovel 一直以来的数据积累,可以构建特定任务的地学问答系统,以及文献中表格抽取的数据集。通过 DataExpo,可以得到数据集相关的知识文本,也可以一定程度上类似科研文献一般,提供地学知识的监督信号。

当然,一定程度上的蒸馏 ChatGPT 确实能辅助模型向 ChatGPT 靠拢,因此针对不同的地学领域,K2 还集成了一套基于 Self-instruct 的指令微调数据集,并且在 ChatGPT 生成之后也通过了专业地学同事的审核,进而得到高质量的监督效果。

最后上海交通大学团队通过人工和机器相结合的方法,对这些指令进行清洗,并最后构成了一套 39k 大小的地学知识性指令微调数据集。在这个数据集中,蒸馏 ChatGPT 的占比并不高,因为在交大团队看来这类数据仅仅只是 QA 任务的一种监督,并不能很好的泛化到其他更难的任务中。

最后,上海交通大学团队聘请了专业的地学翻译专家,将近几年的地学的考研题进行了翻译,并结合美国高中的 AP 考试中的地学相关的科目,构建了 GeoBenchmark,与同等大小的模型相比,K2 以较少的数据成本,最终得到了如下结果:

除此之外,该团队还发现,在微调 K2 的过程中,也是比较有技巧的,如果只利用知识性的指令微调数据,模型并不能达到最好的效果,甚至也只比利用 alpaca 这类开源的和地球科学无关的指令微调数据达到的效果好一些。但是令人激动的是,如果先利用 alpaca 这类指令微调数据进行微调,再利用知识性指令微调数据进行更进一步的训练,达到的效果则更优秀。

目前尚且不知道这个特性是不是只在地球科学领域存在,因为这种现象类似于,先让一个小朋友学会说人话,再学会说行话。面对晦涩难懂的学科,多一条这样的思路,不失为一种方法。

这个现象是否广泛存在呢,答案是很有可能的,在一次由乔治亚大学的买庚辰教授组织的 GeoAI 的研讨会上,来自乔治亚大学和哈佛大学的团队也在训练 radiology 领域的生成式模型的过程中也发现了这一现象。充分说明,要想成为专家,要先学会 “做人”。

在整个过程中,K2 的训练和研发可谓是坎坷曲折,由于领域壁垒较高,因此很难直接获得专家的标注,如果从需求出发,地学领域的需求也很难直接转化为计算机领域的任务。最后,这款地学领域的大模型还是从成功地从计算机角度出发训练完成了,给后续的地学领域的大模型一定的参考意义。

目前看来,在国际社区中,K2 的应用前景非常广阔。例如,它可以用于自然语言理解、结合 GAKG 进行信息检索增强的 QA 任务和文本生成等任务。此外,在未来 K2 还可以用于地球科学领域的知识图谱构建和地球科学文献的自动化分析等方面。在地学类资讯公司的社交圈子里,已经广泛讨论了该团队这一令人激动的工作。例如:

1.https://paulhcleverley.com/2023/08/03/worlds-first-geoscience-large-language-model/

2.https://www.linkedin.com/posts/paulhcleverley_geosciences-largelanguagemodels-artificialintelligence-activity-7093001271632101376-jzAc

经过本文的陈述,计算机赋予地学新的生命,地学赋予计算机新的使命。我们相信,会有越来越多的真正愿意奉献地学的计算机学科专家投入时间,以及真正愿意沉下心来从地学角度给予支持和耐心的地学专家参与进来,地学的 AI 时代将很快到来。

Paper: https://arxiv.org/abs/2306.05064

Code: https://github.com/davendw49/k2

关于 DDE 国际大科学计划

K2 是响应深时数字地球(DDE)国际大科学计划号召,由计算机领域的科研工作者深入地学领域进行数据采集分析,打开了一条计算机科学与地球科学交叉研究的新思路。DDE 国际大科学计划是全国唯一一个国际大科学计划,由中国地质大学王成善院士,中国科学院地理科学与资源研究所周成虎院士等中国地球科学的科学家领导的,致力于建设一个为应对全球科技挑战、支撑全球或者区域命运共同体提供社会所需知识的国际平台来实现聚合全球地学大数据,构建数据驱动的地球科学发现的目的。

好了,关于K2乔戈里,上交大团队推出一个70亿参数的地球科学大语言模型就讲到这。

版权及免责声明:凡本网所属版权作品,转载时须获得授权并注明来源“科技金融网”,违者本网将保留追究其相关法律责任的权力。凡转载文章,不代表本网观点和立场,如有侵权,请联系我们删除。

相关文章

- “铜陵”化工厂爆炸?两名造谣者被查处

- “爷爷”爷爷的石榴树

- “陈老”高山仰止,景行行止 ——读春桃老师所著《国医》

- “知网”中国知网用户委员会两名成员公开亮相

- “宜宾”近2万人参加!2023宜宾长江马拉松开跑:埃塞俄比亚选手包揽全马组男女前三名

- “鲁南”鲁南制药集团建厂55周年:“向新向未来”

- “民谣”玉林民谣,从成都走向深圳

- “亿元”爱仕达董事长陈合林做铁锅起家 公司已连续亏损两年多他有啥招术?

- “营收”“酱油一哥”黯然失色!市值蒸发超5000亿,海天味业遭转型阵痛

- “可持续”“京澳25”公益计划启航

- “模型”北理工团队在人工智能图像识别领域取得新进展

- “炮车”评论丨雾炮车昼夜狂喷监测点?斩断伸向环境监测数据作假之“手”

- “数据”奇富科技知微实验室揭秘黑市数据交易链条

- “互联网”工业互联网驶入“深水区” 中小企业积极性不足

- “数据”市经济和信息化局发布《北京市首席数据官制度试点工作方案》 全面推行政府首席数据官制度

- “之家”西部数据 SN770M 2230 SSD 上架:2TB 1559 元

- “数据”国家数据局挂牌进入倒计时,相关工作紧锣密鼓推进

- “数据”百度中标东方航天港卫星数据智算中心项目,价值3.1亿元

- “梧桐”助力数字中国建设,中国移动正式发布三款梧桐大数据产品

- “交通”告别拥堵,来自北航的TrafficGPT为你分忧